Неделю назад мы писали про Mistral 3 с MoE-моделью на 675B параметров. Сегодня компания представила Devstral 2 — новое поколение открытых моделей для кодинга.

Главное:

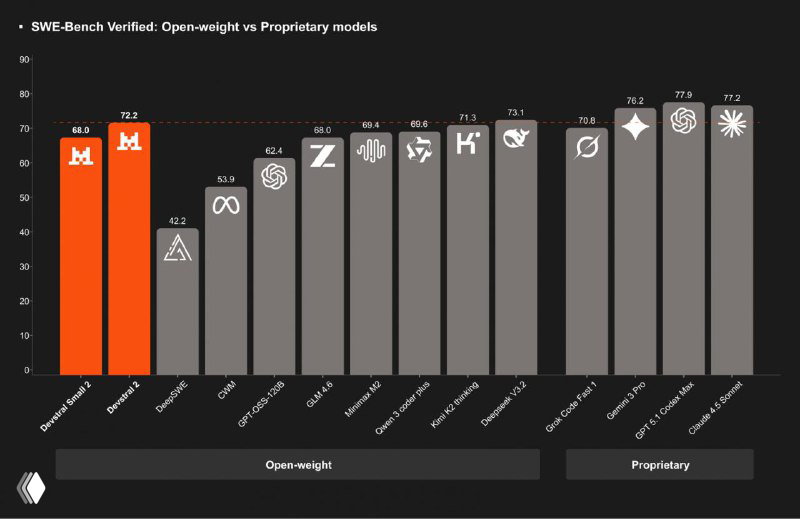

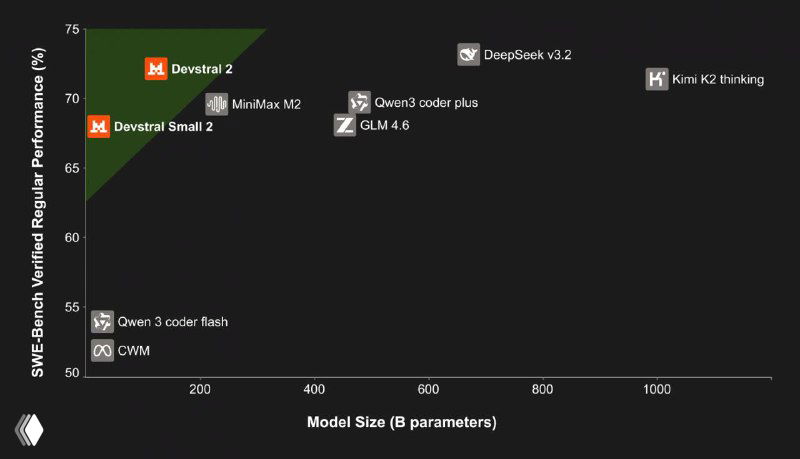

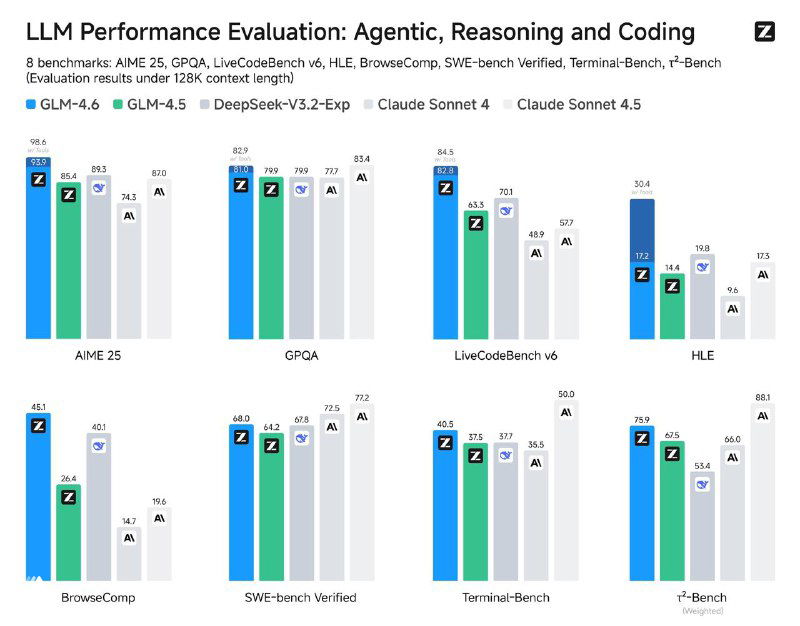

- 🟢 Devstral 2 (123B): 72.2% на SWE-bench Verified, практически новый SOTA среди open-weight кодовых агентов. Чуть-чуть не дотянули до DeepSeek V3.2.

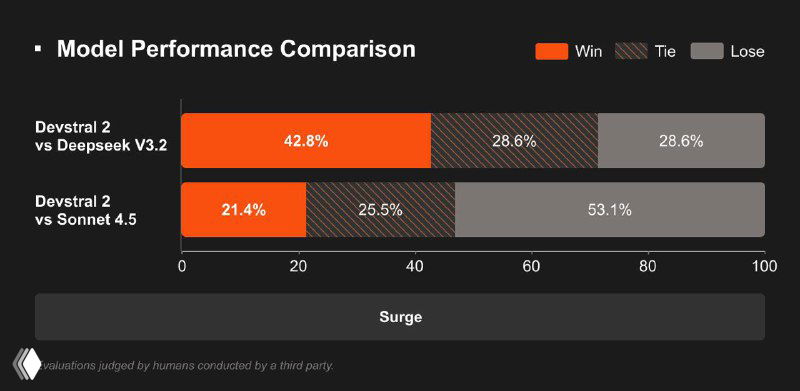

- 🟠 До 7 раз дешевле Sonnet на реальных инженерных задачах.

- 🟢 Devstral Small 2 (24B): 68% на SWE-bench, работает локально на потребительском железе, 256K контекста, Apache 2.0.

- 🟠 Модель бесплатна в API на старте. Доступна на OpenRouter.

- 🟢 Mistral Vibe CLI: нативный open-source кодовый агент прямо в терминале, умеет исследовать проект, вносить многофайловые правки и выполнять shell-команды.

Devstral 2 и Small 2 получились удивительно компактными: они в 5–28 раз меньше DeepSeek V3.2 и в 8–41 раз меньше Kimi K2, но при этом держат уровень, который раньше был доступен только закрытым моделям.

@ai_for_devs