Что завезли: окно контекста теперь не 128k, а 200k токенов (можно загружать целую диссертацию и ещё место останется). Кодинг стал бодрее — модель не только щёлкает бенчмарки, но и в реальных сценариях типа Claude Code и Roo Code показывает себя отлично. Плюс апгрейд по «агентности»: умнее пользуется инструментами, ищет, анализирует, делает выводы.

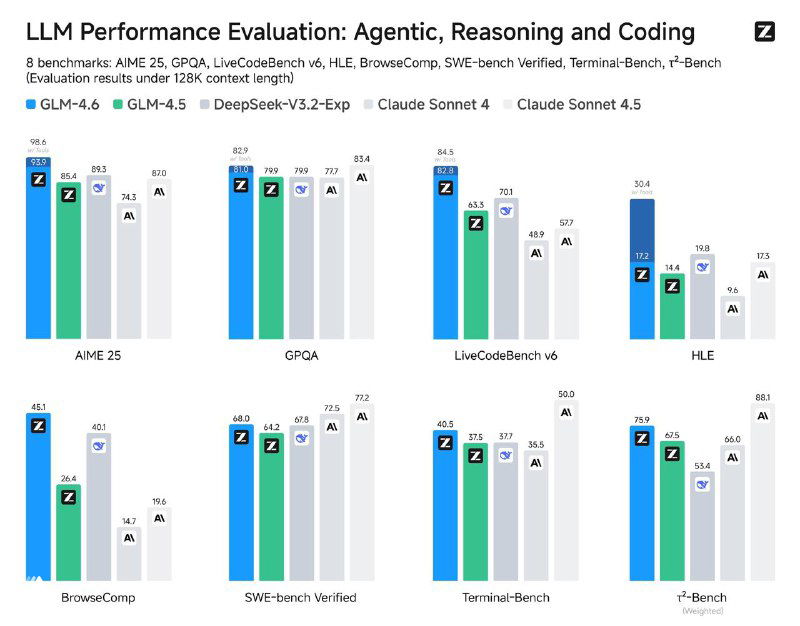

По тестам: GLM-4.6 обходит прошлую версию, уверенно держится против DeepSeek-V3.2-Exp и почти дотягивается до Claude Sonnet 4. Но до свежего Claude Sonnet 4.5 по коду пока не дорос — тут Anthropic всё ещё впереди. Зато по эффективности есть козырь: задачки решает примерно на 15% экономнее по токенам.

В общем, если вы искали «дешёвый claude», то вот оно. GLM-4.6 в Coding Plan стоит в 7 раз дешевле, а квоты выше в 3 раза. Апгрейд подписки автоматический, локально модель можно будет поднять через HuggingFace или ModelScope.

@ai_for_devs