21% специалистов подписаны на 100+ каналов: регуляторика, новости, digital, рекламные платформы и конкуренты. В среднем — до часа скролла каждое утро.

Я автоматизировал это для себя и выложил код на GitHub.

Как это устроено?

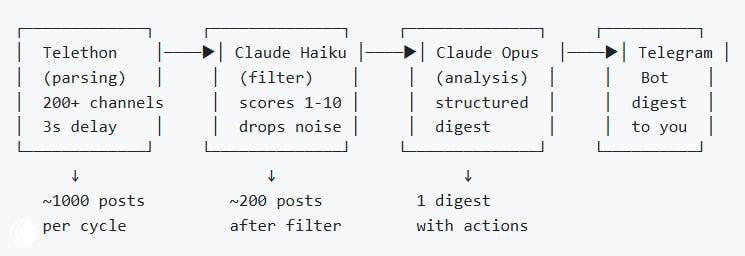

Система работает в два AI-слоя:

Быстрый и дешевый (Haiku)

пробегает по 1000+ постов и отсеивает шум за копейки.Более мощный (Opus)

получает только отфильтрованное и генерирует дайджест с конкретными рекомендациями.

Дважды в сутки бот приносит: сигналы дня, горячие посты, что можно прокомментировать, идеи для контента, материалы в базу знаний.

VPS за 300₽/мес. AI ~$2/день.

В репозитории: рабочий шаблон, архитектура, деплой, обработка FloodWait.

В репозитории нет: промптов, каналов, настроек и фильтров под фарму. Код — commodity. Экспертиза и данные — нет 😉

Ссылка на GitHub → https://github.com/karonskiy-a11y/telegram-digest-bot

Кто хочет получать дайджесты без возни с кодом — пишите в личку. Может из этого эксперимента с вайбкодингом вырастет небольшой продукт. Как базовый в текущем виде, так и более кастомизированные решения.

Вообще подумываю собрать пилот не в экосистеме ТГ. Но при этом еще с несколькими дополнительными слоями фильтров и парсингом отраслевых новостных сайтов и порталов, государственных реестров и регуляторов.