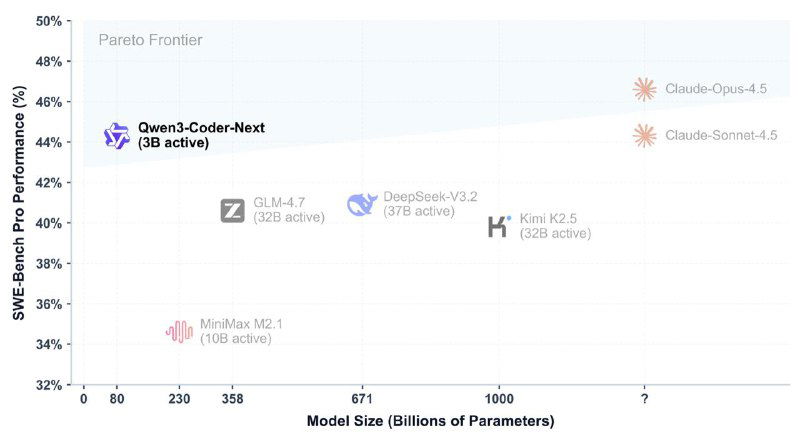

В основе 80B MoE-модель для агентного кодинга и локального использования.

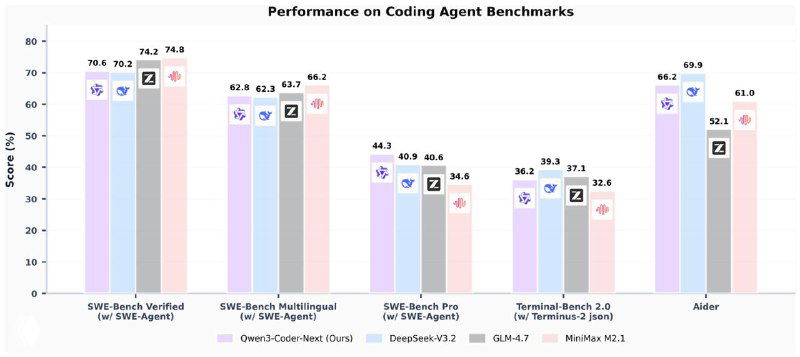

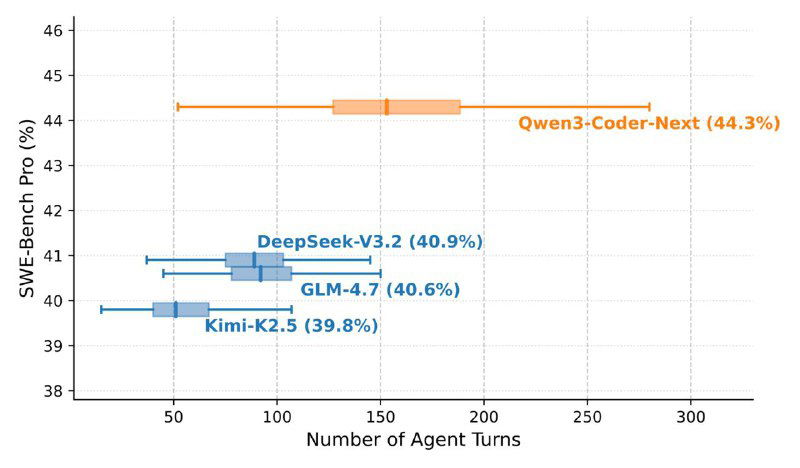

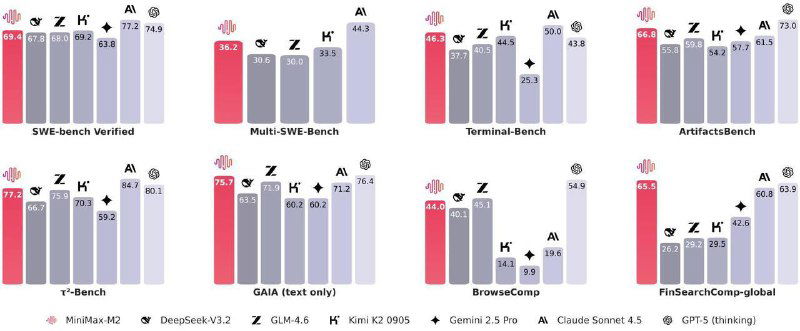

Активных параметров всего 3B, немного, но по агентным бенчмаркам она показывает уровень моделей с 10–20× большим количеством активных параметров.

Контекст — 256K, можно запускать локально, понадобится 46 ГБ ОЗУ/видеопамяти/unified памяти (85 ГБ для 8-бит).

Моделька на Hugging Face.

@ai_for_devs