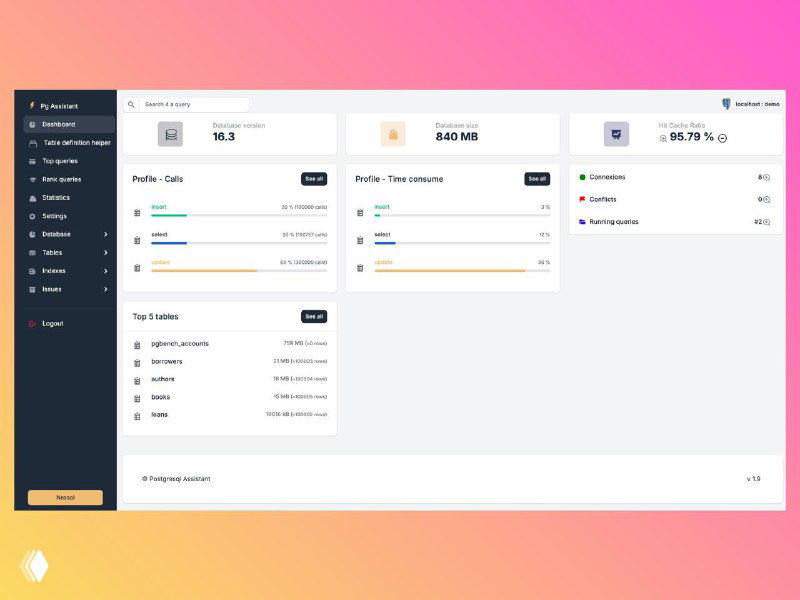

👁 Это CLI-инструмент, который помогает подобрать LLM-модели, реально подходящие под ваше оборудование.

Определяет характеристики системы — оперативную память, CPU и GPU — и оценивает сотни моделей по качеству, скорости, контексту и совместимости. Поддерживает интерактивный интерфейс и классический CLI, умеет работать с локальными рантаймами вроде Ollama, llama.cpp и MLX, а также учитывать квантизацию, MoE-архитектуры и многопроцессорные конфигурации.

❗️ Отлично подойдёт тем, кто запускает локальные LLM и хочет быстро понять, какие модели действительно будут работать на его машине.

tags: #утилиты #ии #llm

Дискуссия