👁 Это идеальный инструмент для генерации текстов, кода и анализа изображений прямо на локальной машине. Нейросеть на вашем компьютере с доступом к 150 000 моделям без интернета и цензуры.

Позволяет быстро обрабатывать запросы с помощью CPU, а модели до 10 млрд параметров работают даже на старых ноутбуках. Для работы используется минимальный набор файлов, который легко запускается даже на устройствах с ограниченными ресурсами.

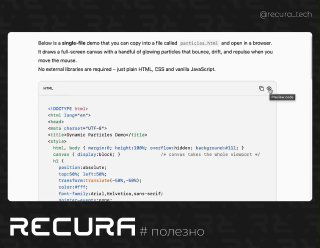

❗️ Идеален для тестирования, генерации кода и работы с большими моделями, а также для создания персонализированных решений без ограничений.

tags: #ии #полезно