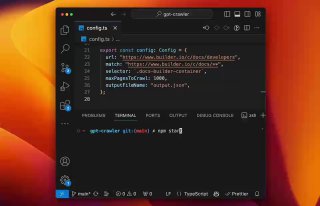

ℹ️ Инструмент для сканирования сайтов и создания файлов знаний, позволяющих обучить собственного GPT на основе одного или нескольких URL-адресов.

🔥 Он автоматически собирает информацию из указанного источника, формируя базу знаний, которую можно использовать для кастомных моделей.

✳️ Например, можно проанализировать документацию Builder.io и создать GPT, отвечающий на вопросы по интеграции этого сервиса.

📱 GitHub: https://github.com/BuilderIO/gpt-crawler

tags: #утилиты #ии #документация

🧭 @recura_tech