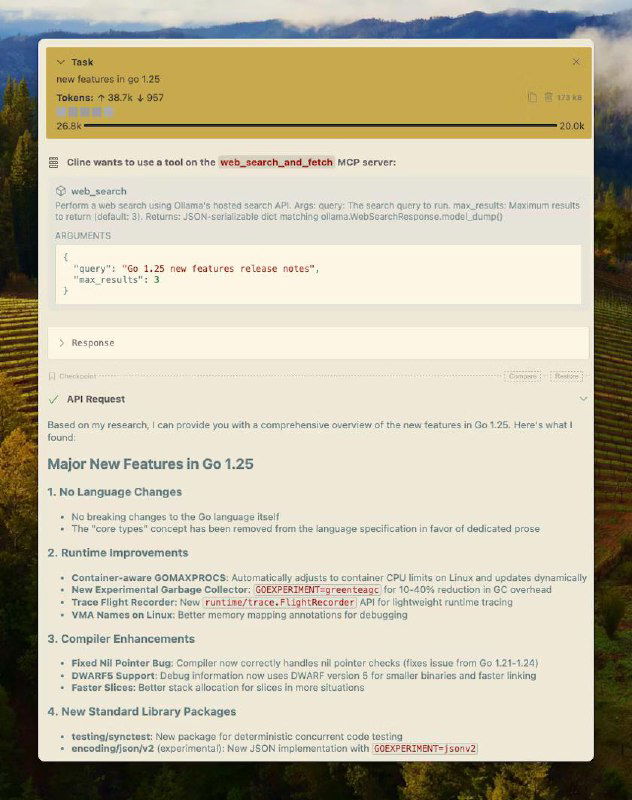

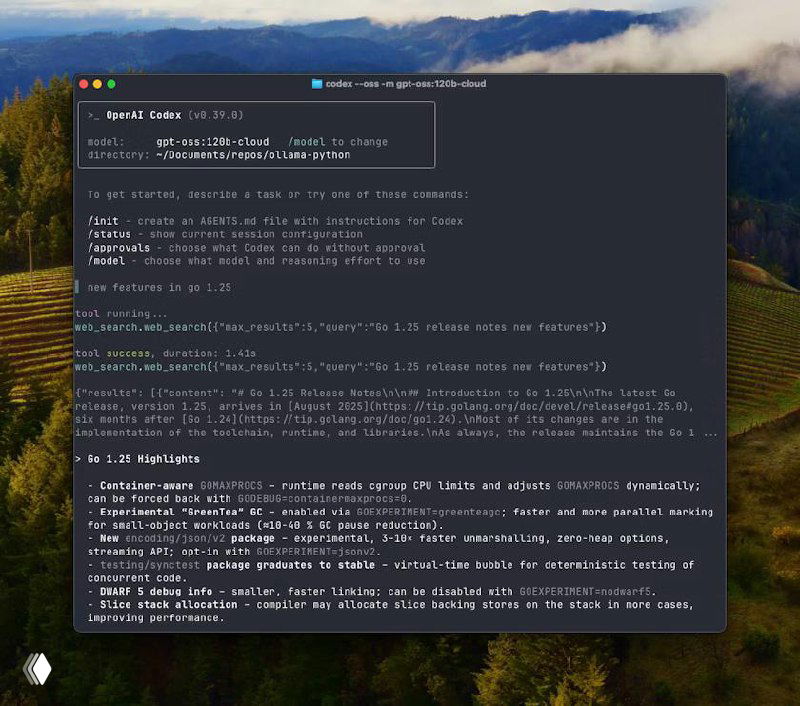

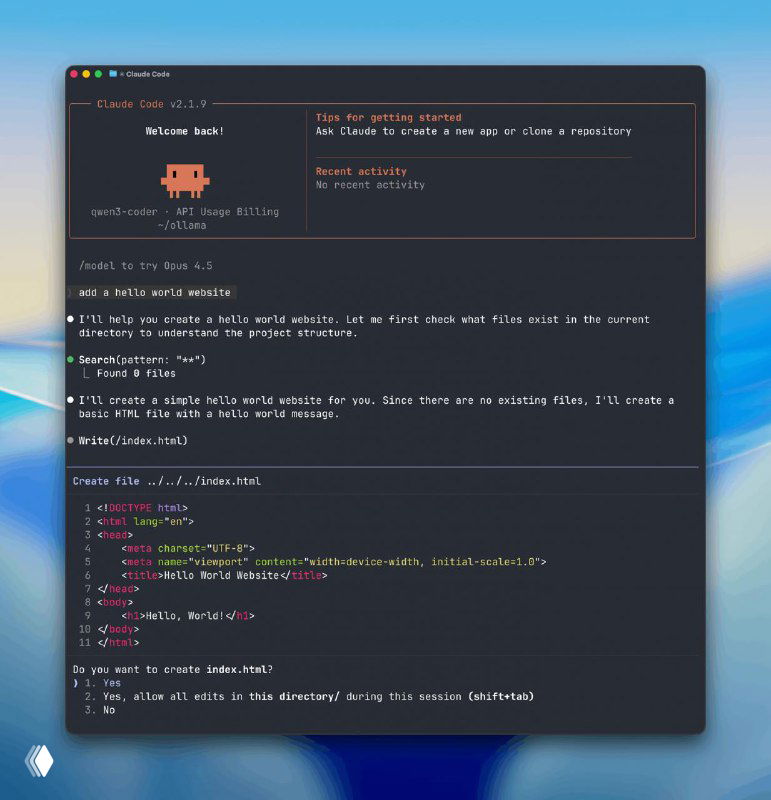

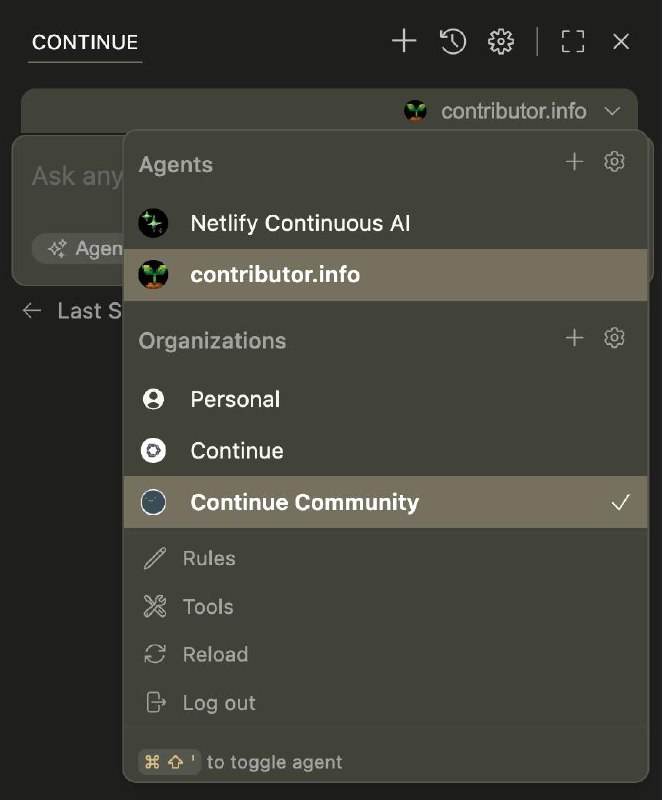

Ollama официально запустила встроенную поддержку веб-поиска через REST API. Это не просто внешний плагин — это часть экосистемы: API интегрирован в Python и JavaScript SDK, а также доступен через MCP (Model Control Protocol) сервер. Цель — снизить галлюцинации и дать моделям доступ к свежим данным без ручного RAG-пайплайна.

Факты по делу:

- Поиск возвращает контент объёмом до нескольких тысяч токенов, поэтому рекомендуемое контекстное окно — минимум 32K токенов.

- Поддержка есть для любых моделей, включая open-weight, например Qwen 3 (4B) — в официальном примере как раз на нём строится простой search agent.

- Интеграция возможна через:

- Прямой вызов REST API

- Python/JS библиотеки Ollama

- OpenAI-совместимый endpoint (полезно для gpt-oss и подобных)

- MCP-сервер — для совместимости с Cline, Goose, Codex и другими инструментами.

Важный нюанс: в документации нет информации о rate limits. Неясно, сколько запросов в минуту/день разрешено, особенно для self-hosted или cloud-версий. Пока предполагаем, что лимиты мягкие — но это нужно тестировать. Как сказано в официальном блог-посте:

Ollama provides a generous free tier of web searches for individuals to use, and higher rate limits are available via Ollama’s cloud.

Если что, стоимость Ollama Cloud – 20$ в месяц, и пока что сервис находится в preview.

@ai_for_devs