Anthropic разобрали миллионы сессий Claude Code и вызовов через API, чтобы понять, сколько автономности люди реально дают ИИ-агентам в проде.

Основные результаты:

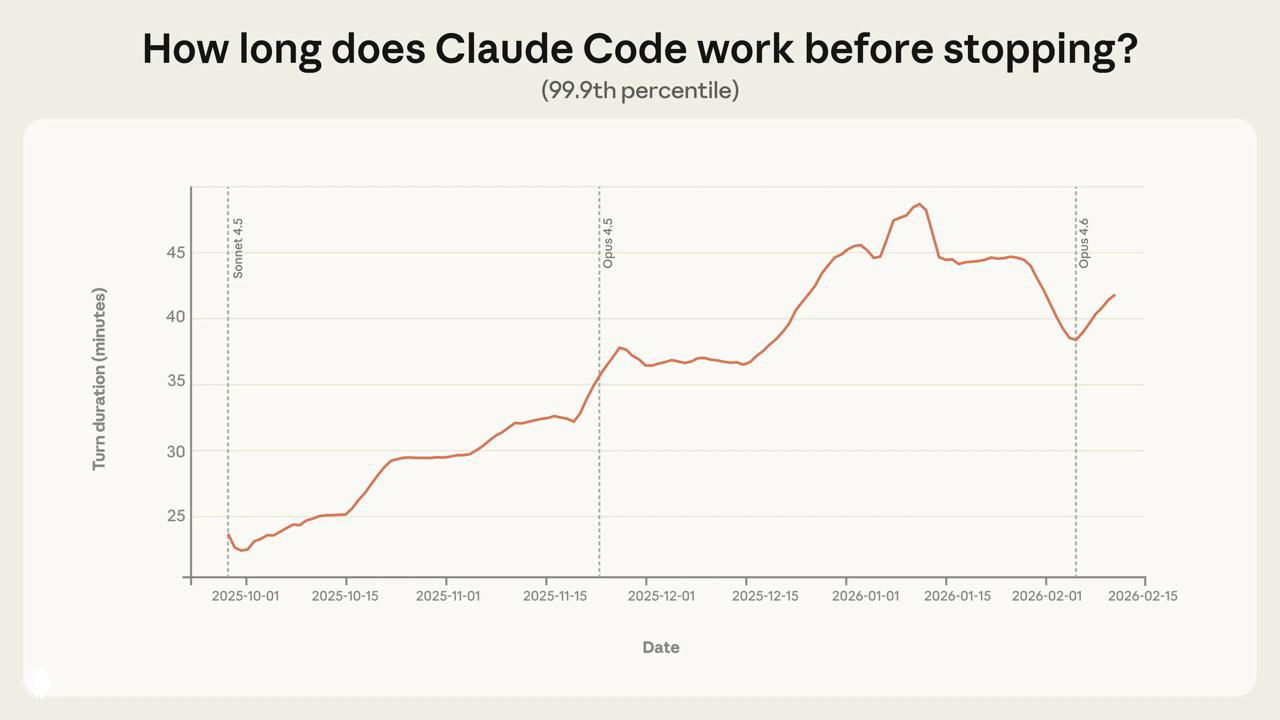

- Самые длинные непрерывные «заходы» Claude Code за три месяца выросли почти вдвое: с ~25 до ~45 минут без вмешательства человека

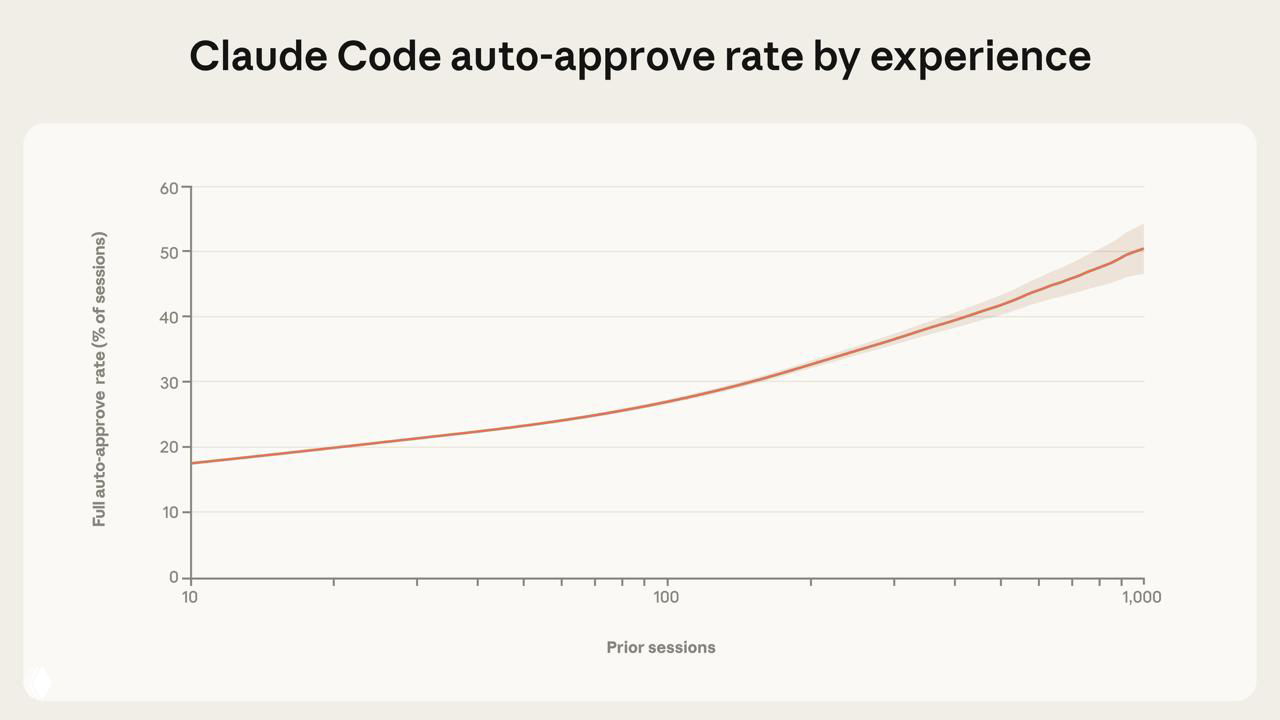

- Новые пользователи включают полный auto-approve примерно в 20% сессий. У опытных — уже больше 40%

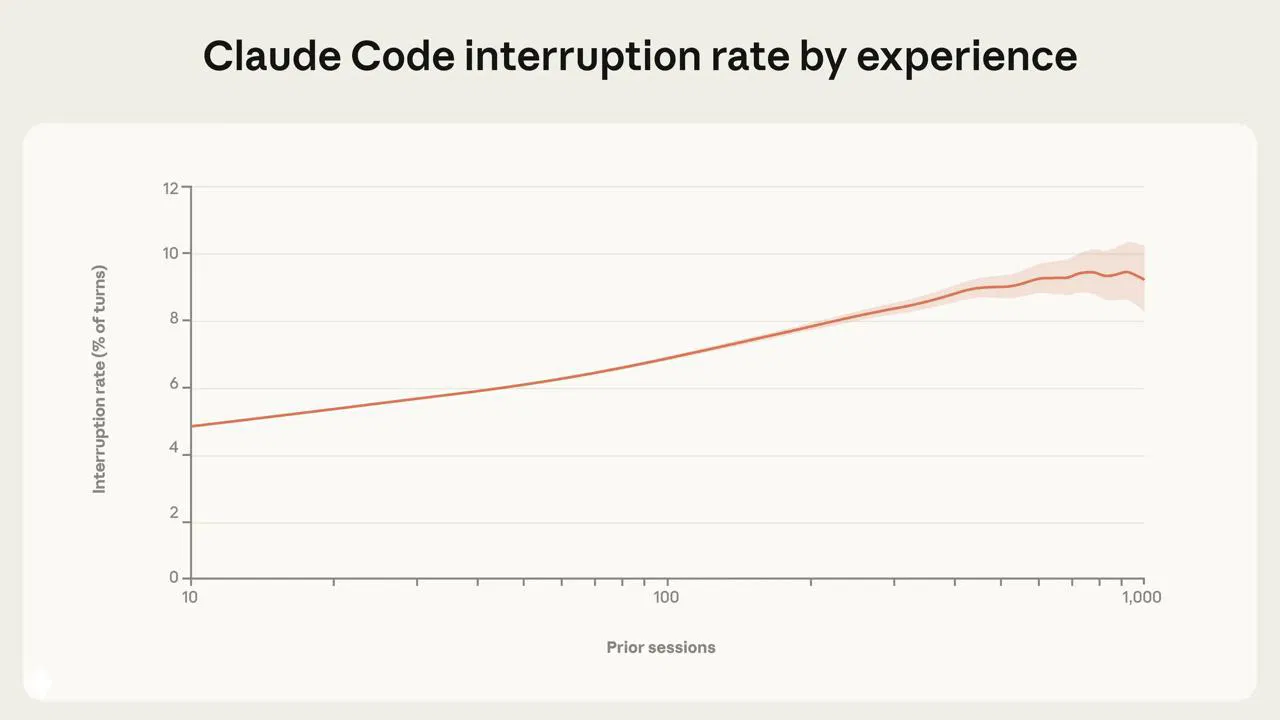

- При этом опытные чаще останавливают агента по ходу работы: около 9% остановок от общего числа запусков против ~5% у новичков

- На сложных задачах сам Claude останавливается с уточняющими вопросами чаще, чем его прерывает человек

@ai_for_devs