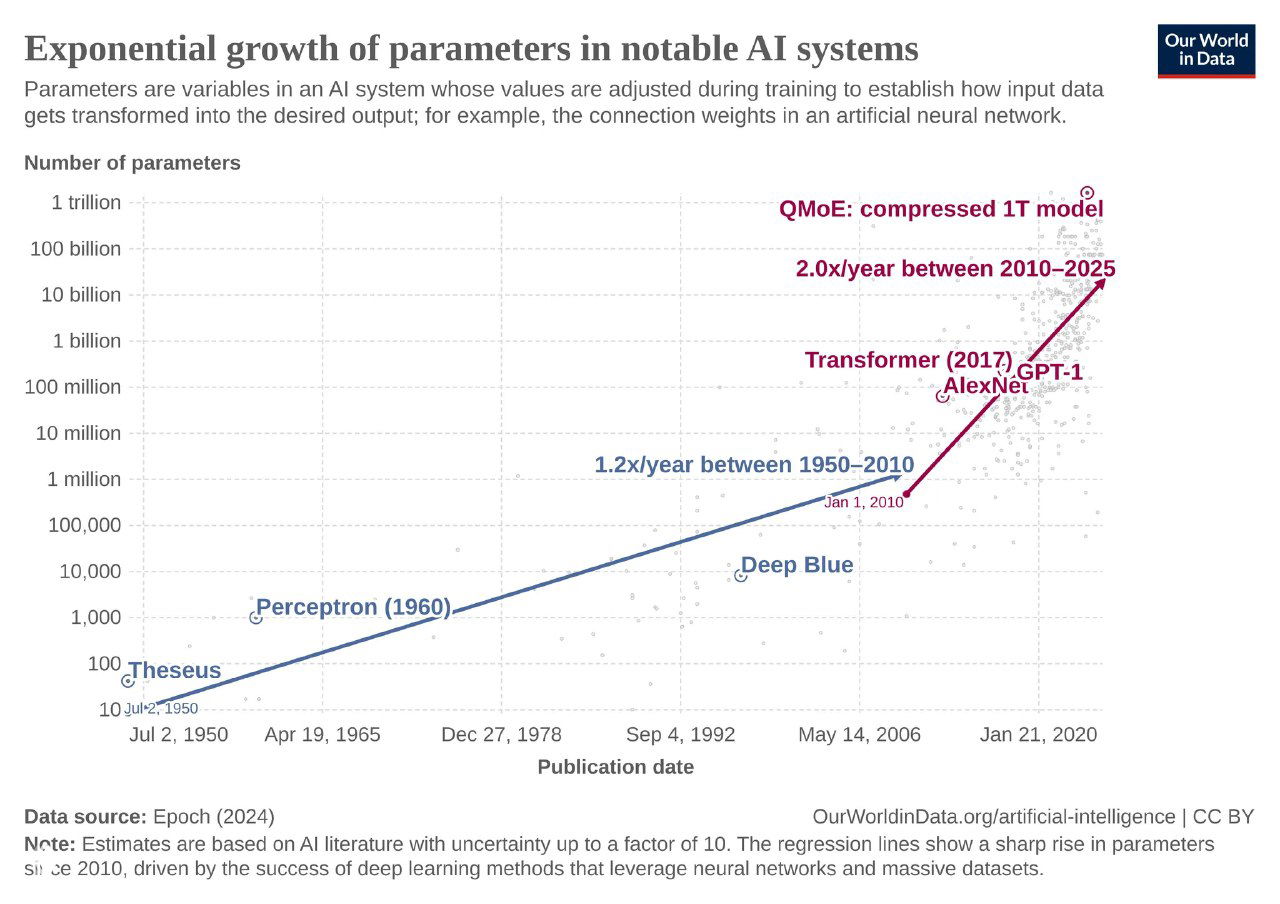

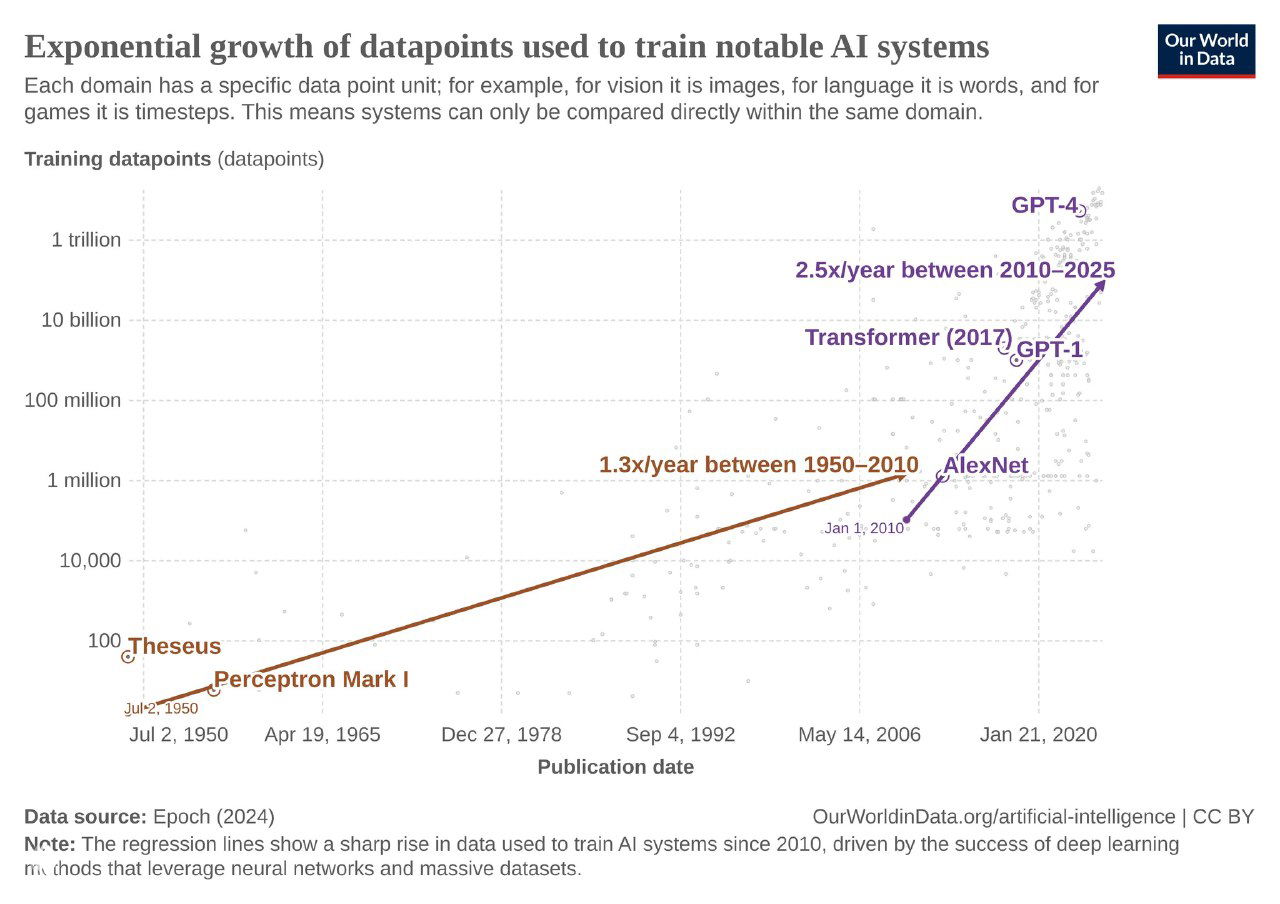

На первой диаграмме — число параметров в популярных системах ИИ. На второй картинке — объёмы данных, используемых для обучения ИИ. Чем больше параметров и данных для обучения у модели, тем сложнее и точнее она будет работать, поскольку будет способна учитывать большее количество взаимосвязей и особенностей данных

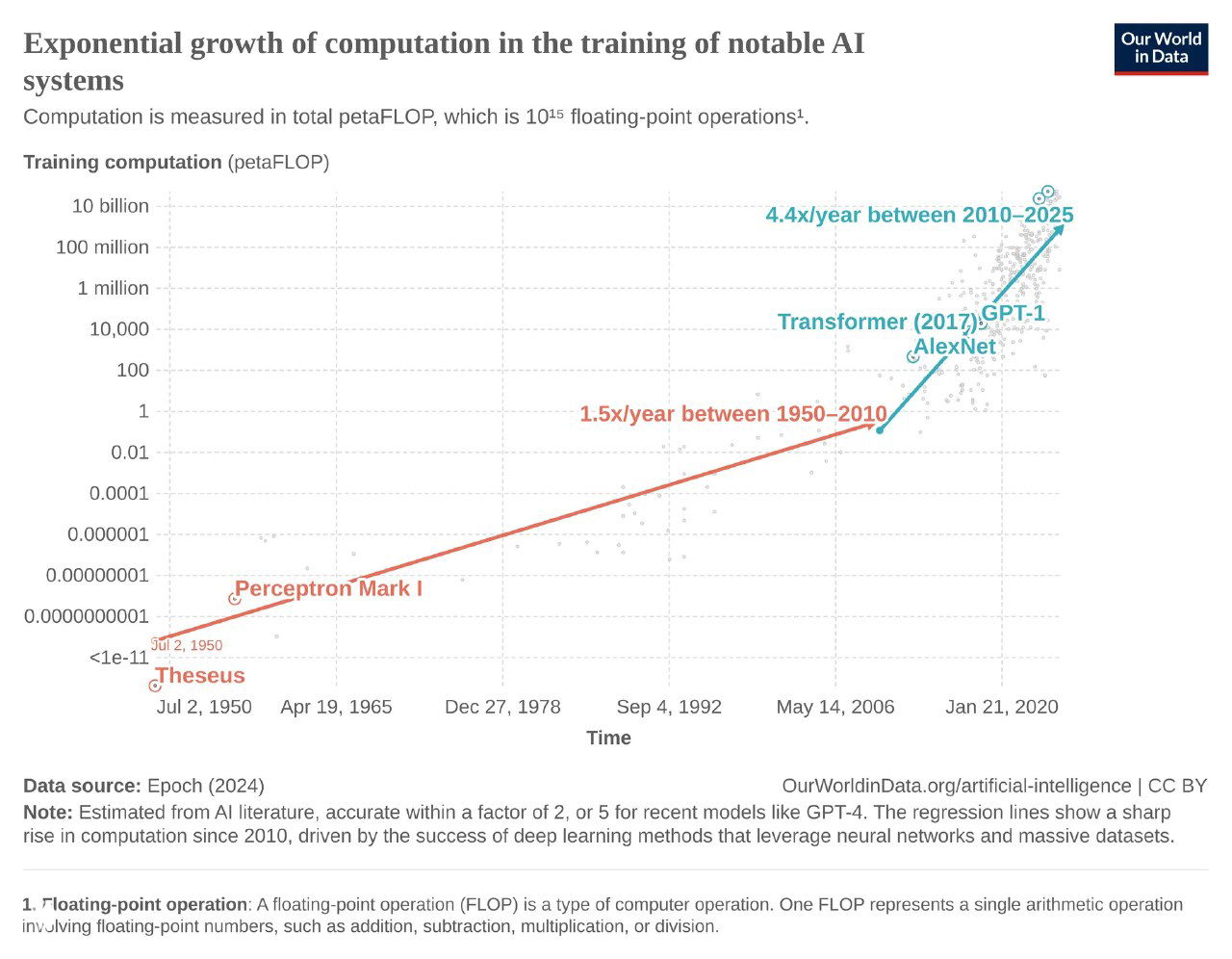

С ростом входных данных и числа параметров требуется всё больше вычислительных ресурсов: высокоскоростных процессоров, специализированных чипов и более эффективных алгоритмов. На последней диаграмме — объёмы вычислений в петафлопсах (1×10¹⁵ вычислений в секунду), необходимых для обучения ИИ-систем

Все шкалы логарифмические

Ещё мы писали про развитие индустрии ИИ:

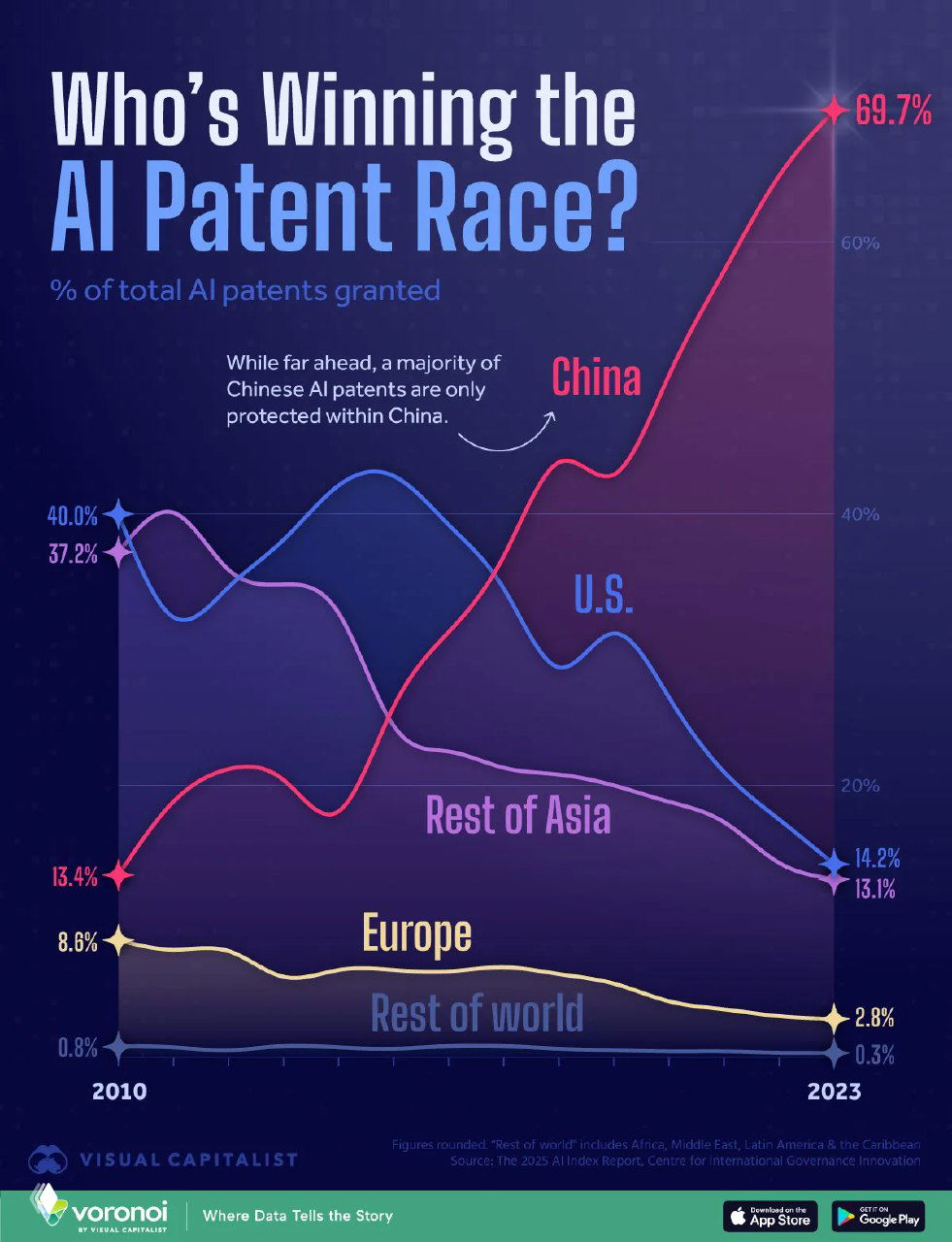

- Индустрия искусственного интеллекта в числах, 2010–2022

- Как менялись возможности систем ИИ по распознаванию речи и изображений относительно способностей человека, 1998–2020

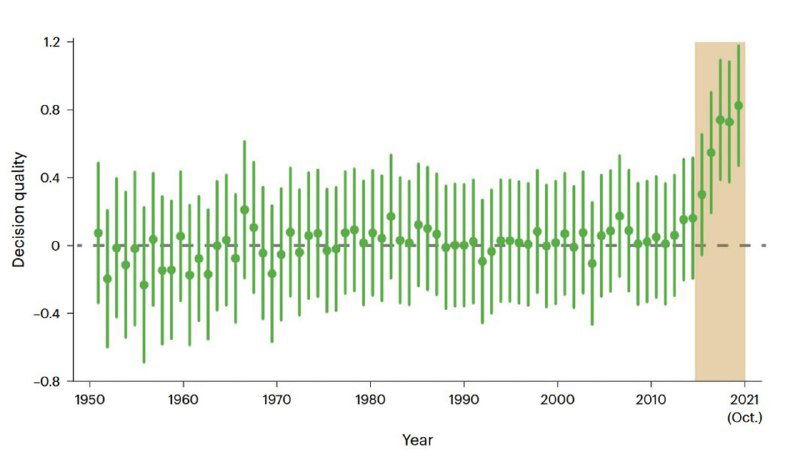

- Вычислительные ресурсы, затраченные на обучение систем искусственного интеллекта, 1950–2022

- Как развивалась индустрия генеративного ИИ, 2014–2023